通过对智能驾驶汽车进行编程,可以使其做出与人类驾驶者类似的道德判断。问题来了,我们是否希望无人驾驶汽车效仿我们,还是希望其做出不同的选择?

◎ 《汽车人》记者 邢秋鸿

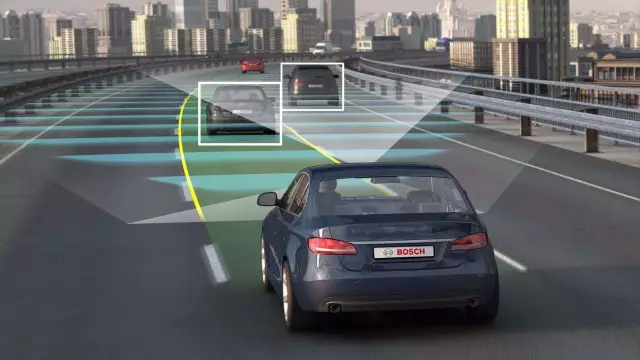

随着智能驾驶技术不断发展,传统车企、互联网巨头、智能驾驶技术提供商都在抢占这块高地,但是道德困境问题一直没有得到真正的解决。现在,德国开始了“以立法规范道德”的第一步。

德国交通运输部近日表示,德国有关部门制定的无人驾驶汽车法律指南,将人的生命安全列为最优先考虑的问题。智能驾驶汽车的软件编程,必须要不惜一切代价地考虑如何避免对人造成伤害或死亡。这意味着,当事故不可避免时,智能驾驶系统必须选择对人造成伤害最小的一种解决方式,其代价可能是牺牲道路上的其他动物或财产。

将“道德准则”纳入智能驾驶编程,并非我们想象中的那么难。此前,德国奥斯纳布吕克大学的认知科学研究所的一项研究发现,人类开车时做出的道德决定,并不像人们之前认为的那样复杂或依赖环境。这意味着,通过给智能驾驶汽车编程来做出伦理决策是相对容易的事。

简单地说,就是通过对智能驾驶汽车进行编程,可以使其做出与人类驾驶者类似的道德判断。问题来了,我们是否希望无人驾驶汽车效仿我们,还是希望其做出不同的选择?

此外,还有另一个显而易见的问题。在德国新制定的立法中,还有一个隐含的条件,在不可避免的事故中,人的生命优于其他。但在另一项事故中,并没有除人之外的其他选项,又该怎么办?

举个例子,想象如下场景:在高速公路上,你驾车前行,前方是一辆大货车,左侧是一辆SUV,右侧则是一辆摩托车。突然,前方大货车上的货物松动脱落,你的车没有办法在如此短的时间内实现制动。你的选择有三个——直接撞上前面的货车或其脱落的货物、撞向左侧的SUV、撞向右侧的摩托车。

笔者认为,很少有驾驶者会选择牺牲自己,而直接撞向大货车。出于自卫心理,驾驶者撞上摩托车的可能性较大。

此时,无论驾驶者做出何种行为,都只是应激反应,是一种潜意识的行为,并非经过大脑思考而做出的决定。但对于智能驾驶来说,它是在执行程序中的一个算法,或许可以称之为“优化撞车”。

在著名的机器人三原则中,第一条就是机器人不得伤害人类。在上述情形之下,智能驾驶可以说是陷入了两难。谷歌首席工程师安德鲁曾表示,当智能驾驶汽车面临两难选择时,“答案差不多总是‘踩刹车’”。显然,踩刹车并不是一个正确的应对方式,看起来总有些像预先编写“谋杀”。

类似的情形在智能驾驶领域并不少见。此前,德国联邦交通运输和数字基础设施部曾发布20条与无人驾驶汽车相关的伦理原则。其中一条是,如果一个孩子突然冲到马路上,为了躲避孩子,汽车就必须撞到人行道;但此时,人行道上恰好有一个成年人。那么,无人驾驶汽车此时会选择撞上孩子。因为他导致了这次重大风险,所以失去了得救的资格。

作为驾驶者,有人认为自己会做出同样的行动,有人则会选择另一种方式。在今天的社会对此都没有一个统一的答案之时,如何能通过算法来掌握“生杀大权”呢?

有的时候,我们希望能够借助算法帮我们实现更为准确的判断。目前来看,算法并不是万能的,智能驾驶的道德困境仍然存在。

德国的立法也并没有完全涵盖道德困境的全部。发展人工智能并应用于频繁涉及道德、伦理的交通领域,其困难远大于我们的想象。(《汽车人》记者/邢秋鸿)【版权声明】本文系《汽车人》独家稿件,版权为《汽车人》所有。如需转载,转载方必须与“汽车人传媒”(邮箱:qcr007@126.com或电话:010-63135250)联系,获得同意取得转载授权,否则必将追究法律责任。敬请关注“汽车人传媒”公众号(qcr0505)。