从广义上而言,自动驾驶发展到最高阶段——L4级无人驾驶,就可以将其视作人工智能的一个分支。至少,人工智能是其中最可能的解决路径。

◎ 《汽车人》记者 黄耀鹏

这两年,人工智能研究并未像2015年预期的那样“爆发”,更未出现令人震撼的产品。产品进展乏力,但巨头们没闲着。越是基础的东西,巨头越会去做。谷歌去年将人工智能和自动驾驶的机构和团队彻底分开,前者留在Google X试验室,而后者则拆分出去作为Waymo公司。让后者尽快做产品的意图昭然若揭。

国内号称最像谷歌的公司百度,则做了相反的事情,将人工智能和自动驾驶团队整合为“智能驾驶事业群”,而原来的人工智能部门(L4)“好几百个人工智能项目”(吴恩达语)哀鸿遍野。抛开纷乱的内部人事,战略调整反映了谷歌和百度对待自动驾驶和人工智能关系的不同认识。

终极途径?

自动驾驶大家都很熟悉,汽车圈内鼓噪最多的莫过于该领域。人工智能(AI)尚未获得高关注量,这与其概念不够“大众化”有关。科技公司对人工智能的投资甚至高于自动驾驶,毕竟前者的一些细分领域,能够在短时间内做出产品,尽快收回投资。

从广义上而言,自动驾驶发展到最高阶段——L4级无人驾驶,就可以将其视作人工智能的一个分支。至少,人工智能是其中最可能的解决路径。

人工智能是对人类思维过程的模拟,也是对人类处理信息的模拟。不过,就目前而言,计算机和人类处理信息的方式大相径庭。换句话说,目前计算机不像人类那样思考。

而且,人工智能的定义,也随着技术的发展不断改变内涵。以前科学计算和工程计算需要聪明而严谨的头脑,现在这些任务几乎都由计算机来完成,比人类更准确、更快速。但我们已经不把这些任务视作“需要人类智能才能完成的复杂任务”。人工智能瞄准的,永远是更有意义、更困难的目标。

目前,在量产车上搭载的行车电脑ECU(包含微处理器、外围电路、存储器和接口)可以做之前人类才能做的事。在它的指挥下,自动变速箱通过液力变矩器调整传动比,轻松换挡。而转向机构则会感知方向盘的动作,产生助力。在高速行驶中遇到变道行驶或侧风、路面倾斜等外部干扰时,驾驶人可以自如操纵方向。低速转弯时前后轮转动方向相反,可以轻松通过以前需要多次转弯才能通过的小弯。尽管现在ECU能做这么聪明的事,但我们都不将其看做人工智能。

如何满足不知满足的人类呢?人工智能需要超越现有人类认知水平和能力。被惊倒的人们自然将王冠奉上,并日益依赖更聪明的人工智能。

两种人工智能

如何让计算机看起来不那么蠢呢?如果计算机有情感,它会发现人类的推理能力实在是弱爆了。逻辑的层级和旁路拓展多到一定地步,人类就无法记住众多的信息和它们彼此的关联,更别提放在一起分析了。

相反,人类的直觉值得肃然起敬。人善于将复杂问题简化,然后用直观判断的方式直趋答案。隐藏的信息是否足以支持做出精准的判断?虽然不总是正确,但这样耗费的时间和精力都是可接受的。我们放弃了一些表象,捕捉隐含信息(学术上称为“次表征”),从而追求更快地解决问题。

人们期待计算机的“思考”方式能够模拟大脑结构。AlphaGo在与人类对弈的过程中,基于神经网络的深度学习(以及强大的记忆能力),摒弃了穷举的笨办法。而1997年IBM“深蓝”战胜卡斯帕罗夫,除了储存海量对局外,就对每一个可能的“下一步”进行穷举计算。核心是评估每一个棋子的价值。显然,对于围棋,该方法完全用不上。

不过,不管是深蓝,还是AlphaGo,都是人类眼中的弱人工智能。它们只能按照既定程序办事,AlphaGo不会开车,而深蓝也不会下围棋。如果围棋的棋盘变成20×19,李世石稳赢,而AlphaGo则可能不知所措。

人类需要的是“通用人工智能(General AI)”。该智能可以下棋、聊天、认识朋友、开车。人类可能很难猜到它下一步将会如何,就像很难洞察另一个人类一样。但它的行为,按照人类行为准则,一定是明智、合理的。

这样的人工智能必然立足于“机器学习”。本地算法无法涵盖所有路况,设计者必须赋予无人驾驶系统一定的自主权,避免在特殊路况下该系统不知所措。和人类一样,计算机仍然要先搜集大量数据样本——各种路况下的驾驶行为,而人类也需要反复练习,锻炼预见性和形成固定的肌肉记忆。

机器学习,实际上将人类学习过程“外化”。选择合适的模型,让模型学习样本,从而找出数据的内在规律,从而形成对未知路况的“经验”。

面对复杂外界条件,人工智能仍然需要基本的预设应对策略。在人类无法厘清复杂的因果关系时,不需要为人工智能设立先决条件和成熟策略(也无法做到)。事实证明,机器学习,更善于从海量数据中抽象出若干有价值的因素,同时确定因素之间的相关性。从而确立应对策略。

比如,在城市快速路上行驶的驾驶员,主观上对突然出现的行人缺乏预期,因为法律上禁止行人穿行。人工智能也同样很难从样本中学到,如何在封闭道路上如何对付突然出现的障碍,也就是“逾规则”状态下的应对能力。

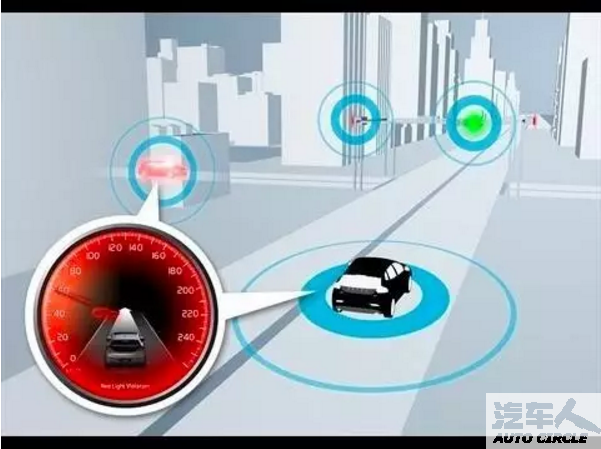

理论上,无人系统的传感器(比如Lidar)可以比人类驾驶员更早地发现违规行人,即环境感知。

假设行人采取不明智的做法,如加速奔跑、快速从车前穿行等。人类驾驶员如果发现刹车距离不够,将面临两难,如果直接将刹车踩到底,有很大概率发生碰撞;如果一边变线一边刹车,很可能与同向车辆发生碰撞,引发更严重的事故。而观察相邻车道的情况则导致更多的时间延迟,这种情况下,人类很难做出最佳选择。

人工智能系统则会对行人行为模式建立模型,根据其肢体动作,预估其下一步的位置,同时收集相邻车道和交通标志线信息。在20ms内计算出,多少转向力度和刹车力,才能保证自身安全和避免碰撞,即决策协同。

最后的动作,则驱动车辆完全实现此前的计算,即控制执行。

其中的核心在于预估对方的行为。只有“强用人工智能”才有可能做到这一点。赋权不够或者学习能力不足的本地计算机,将无法胜任。这也是未来的无人驾驶系统必然是“强人工智能”的原因,虽然这个概念备受争议。

恐惧源头

可以预见的是,完全由无人驾驶车辆组成的交通网络里,人工智能本身将形成另一套交通规则,无须而且排斥人类的参与甚至干预。

比如,人类驾驶车辆在时速120公里时,通常要保持100米以上间距。而无人驾驶车辆则可以形成紧密的车队,以减少风阻,间距可以减少到数米,而时速则可以提升到200公里以上。同时,一辆车所见的场景,也会被其他车辆所见。它们的感官由于高速通讯而得到延伸。

不过,一旦强人工智能即将实现,人类将陷入更深的担忧。因为其强大的学习能力,自我进化速度极快,很可能产生自我意识,不愿意被人类束缚。而人类对其思维和执行缺乏预见。即便可以执行完全无害的任务,也会因为不可预知性而让人类害怕。

马斯克和霍金都已经发出严厉警告。强人工智能实现之日,被称为“奇点”,可能会导致凯文·凯利所称的“失控”。

马斯克还举了个例子:“比如你创建了一个可以自我完善的AI来摘草莓,这个AI可以干得越来越好,摘得越来越多。不过,这个系统想做的事情就是摘草莓,所以它可能会把全世界都变成草莓园,永远都是草莓园。”

人工智能的自我意识觉醒,无疑是非常可怕的。不过,拉里·佩奇相信,人工智能的善恶取决于创造者。科技公司仍然普遍致力于增强型人工智能的研究。

毫无疑问,自动驾驶的终极解决方案是强人工智能,但有远见的学者都对此表示强烈的担忧。这是否意味着我们应该在此之前“踩刹车”或者另辟蹊径?一条风景极佳的道路尽头是深渊?糟糕的预期,很可能来自我们恐惧的源头——我们从未面对过比我们更聪明的实体。(《汽车人》记者/黄耀鹏)【版权声明】本文系《汽车人》独家原创稿件,版权为《汽车人》所有。欢迎转载,请务必说明出处及作者,否则必将追究法律责任。敬请关注“汽车人传媒”公众号(qcr0505)。